指令微调是一种自然语言处理技术,通过让预训练语言模型学习遵循人类指令的方式来优化其性能。它的核心原理是使用包含指令-响应对的数据集对模型进行二次训练,使模型能更准确理解并执行用户的具体指令,而非仅生成连贯文本。与传统微调专注于特定任务(如分类、翻译)不同,指令微调强调模型对各类自然语言指令的泛化理解能力,让模型更贴近人类交互习惯。

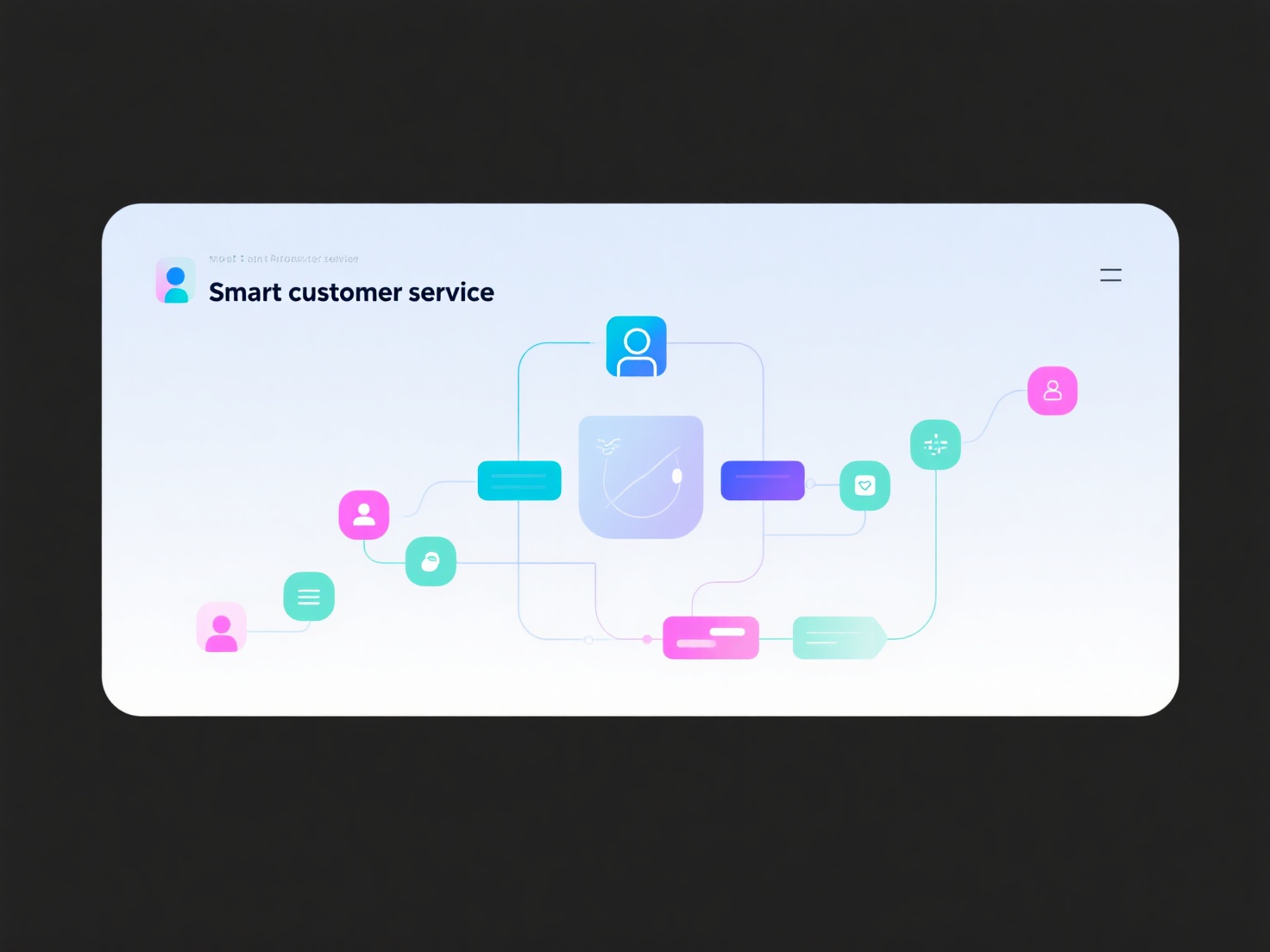

在实际应用中,指令微调广泛用于提升大语言模型的对话能力和任务执行精度。例如,OpenAI在GPT系列模型开发中采用指令微调,使模型能更好响应“写一封邮件”“总结文档要点”等日常指令;Anthropic的Claude通过该技术增强了对复杂指令的拆解与执行能力,常见于客服机器人、智能助手等场景。

指令微调的优势在于显著提升模型的可用性和交互友好性,降低用户使用门槛。但也存在局限性,如高质量指令数据集构建成本高,且过度优化可能导致模型对模糊指令过度自信。未来发展方向将聚焦于多模态指令理解和跨语言指令泛化,推动模型向更智能的通用助手演进。